Appearance

LLM

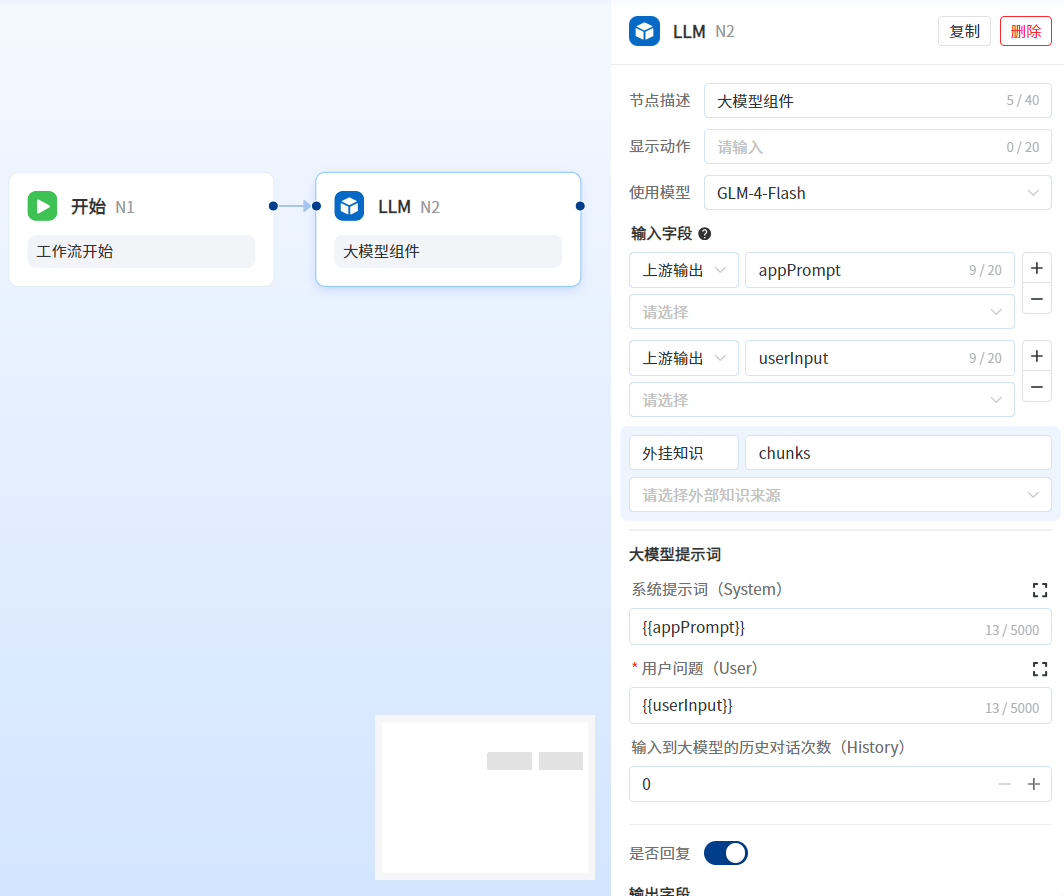

大模型组件,使用大模型能力的核心组件。

使用模型

选择使用的模型,根据任务需求切换不同大语言模型,模型输出效果和提示词有关(相同的提示词用不同模型,输出效果不同)。输入字段【appPrompt】

默认存在,用于接收开始节点的【appPrompt】,接收后可在提示词中以快速引用。也可以自定义新的参数,供【系统提示词(System)】引用。注意,这里使用的是,而不是{{Nx.输出字段名称}}输入字段【userInput】

默认存在,用于接收开始节点的【userInput】,接收后可在提示词中以快速引用。也可以自定义新的参数,供【用户问题(User)】引用。输入字段【外挂知识】

需要和【混合检索】组织一起使用,接收chunks格式参数,并拼接到提示词中输入给大模型,详情在混合检索中说明。【回复引用】

选择【外挂知识】后显示,打开输出混合检索的知识库引用,关闭则不输出引用。 大模型提示词【提示词(System)】:输入给大模型的提示词指令,指导大模型生成逻辑。可以通过NaN引用上游变量值。大模型提示词【用户输入(User)】

输入给大模型的当前问题,通常引用userInput参数。也可以接收上游节点处理过的字符串或接收开始节点显式显示的messages参数。大模型提示词【输入到大模型的历史对话次数(History)】

限制历史长度,方便根据需求自定义上下文长度。计算规则:默认为0,表示不带入历史问答;1表示带入最新一次完整的问+答,2表示带入最新的两次完整的问+答,以此类推,最大为5。【是否回复】

开启表示将该节点的输出显示给用户端,关闭表示不输出该节点的输出给用户端【输出字段】

LLM组件的输出字段用户不能自定义。